Maneggiare con cura

L’Intelligenza Artificiale (IA) costituisce un’importante sfida tecnologica e pone quesiti che dobbiamo affrontare subito, per trovare soluzioni d’uso che siano proficue ed efficaci. E dell’IA Stanley Kubrick aveva descritto capacità e limiti già 55 anni fa, nel film “2001: Odissea nello spazio”. Prendendo spunto da questa pellicola, abbiamo parlato con Daniele Caligiore, dell’Istituto di scienze e tecnologie della cognizione del Cnr, dei rischi - ma anche degli indiscutibili vantaggi - che il suo utilizzo porta con sé

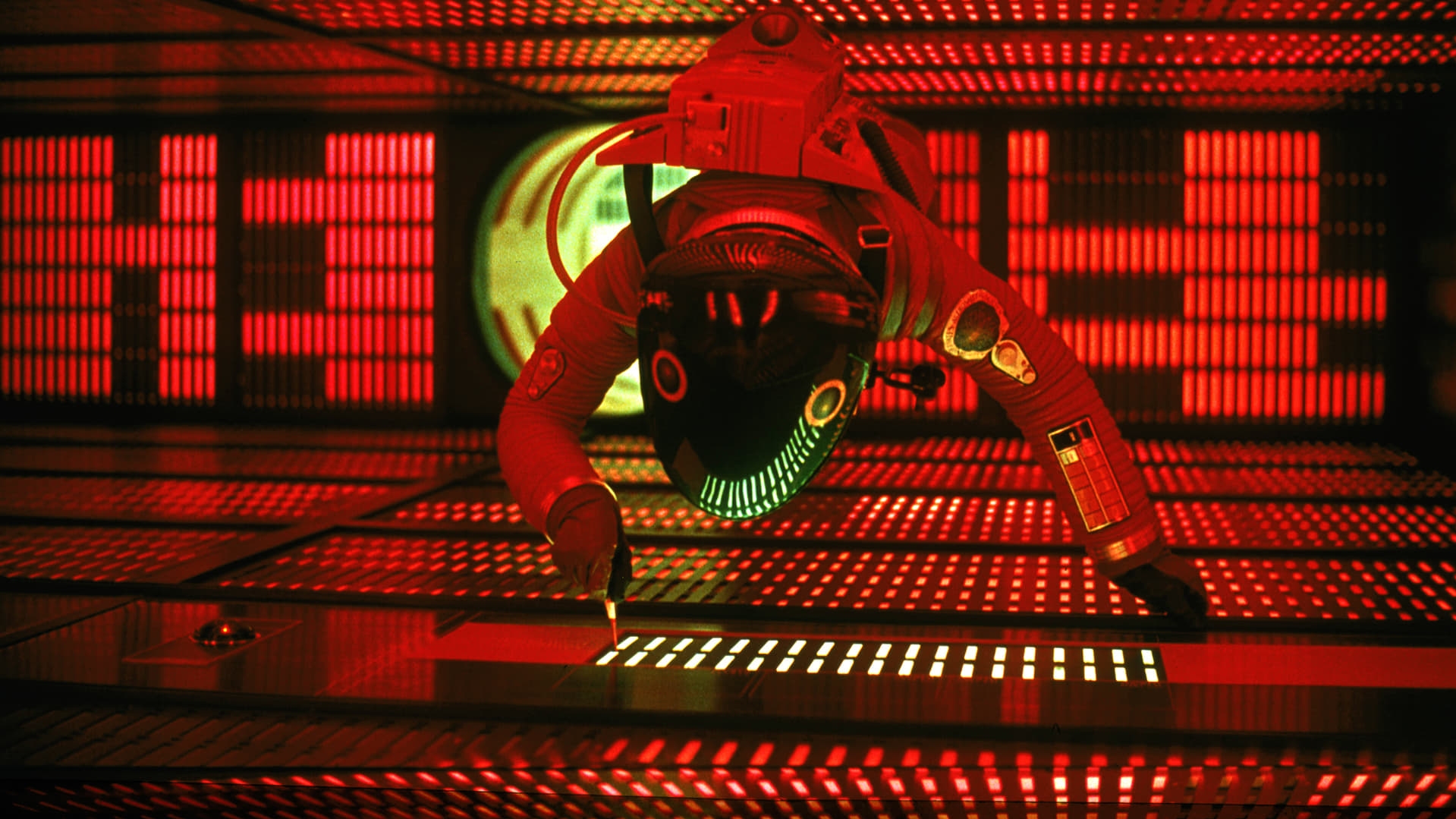

Nel 1968 esce “2001: Odissea nello spazio”, ottavo lungometraggio del regista statunitense Stanley Kubrick, nel quale il cineasta si misura per la prima e unica volta con il genere fantascientifico, un film che gli valse l’Oscar per i migliori effetti speciali. Uno dei protagonisti della pellicola è HAL 9000, il supercomputer che gestisce le operazioni a bordo della nave spaziale Discovery; presentato come una macchina infallibile, dopo aver dato segnali di malfunzionamento, si ribella alla possibilità che venga disattivato uccidendo quasi tutti i membri dell’equipaggio, a parte il capitano David Bowman (Keir Dullea), che riesce a inibirne il funzionamento. HAL 9000 è forse il primo esempio di Intelligenza Artificiale (IA) presentato sul grande schermo, e Kubrick ne dà una raffigurazione in chiaroscuro, una chiave di lettura contemporanea dei pericoli che possono celarsi dietro a una tecnologia dalle enormi potenzialità.

L’IA è molto presente nel nostro quotidiano e all’epoca della realizzazione del film era già diventata oggetto di studio da oltre 10 anni. Nel corso del tempo, questa tecnologia si è sviluppata prendendo spunto anche dai processi cognitivi propri del mondo animale. “L'Intelligenza Artificiale è una disciplina le cui origini risalgono agli anni '50 del secolo

Il futuro dell'IA si presenta promettente, ma anche pervaso di questioni controverse e complesse. Oltre a offrire opportunità di innovazione e di crescita economica, pone interrogativi di tipo etico e sociale che richiedono una grande attenzione, in un contesto storico nel quale la contraffazione e la falsificazione stanno mettendo a dura prova la possibilità di distinguere la realtà dalla finzione. “Esistono tecnologie basate sull'Intelligenza Artificiale, come il riconoscimento di modelli e firme per autenticare i prodotti anche se, con l'evolversi della tecnologia, i metodi di falsificazione stanno diventando sempre più sofisticati. È essenziale continuare a sviluppare soluzioni di contrasto avanzate, come sistemi di tracciabilità e autenticazione basati su blockchain e, appunto, sull’IA”, conclude il ricercatore del Cnr-Istc. “Ad ogni modo, i rischi correlati a essa sono anche e principalmente di tipo etico: si pensi alla possibile perdita di posti di lavoro dovuta all'automazione, alla discriminazione algoritmica (dataset inesatti, incompleti o non aggiornati producono risultati non affidabili), alla violazione della privacy e alla sicurezza dei dati. Per affrontare tali problematiche in modo efficace sarà fondamentale sviluppare politiche e regolamentazioni appropriate, promuovere la trasparenza negli algoritmi, garantire l'equità nelle applicazioni dell'IA e coinvolgere esperti provenienti da diversi settori per la definizione delle linee guida. L'‘AI Safety Summit’, la prima conferenza internazionale sul tema che si è svolta pochi giorni fa in Inghilterra, rappresenta un primo passo per affrontare tali problematiche e definire strategie comuni. Quest’ultimo aspetto sarà fondamentale per far sì che l'Intelligenza Artificiale possa essere impiegata in modo sicuro e vantaggioso per tutti”.